Del 3: ”Ping, ping, ping” – men ingen tar emot systemets larm

De är maskiner men de talar som människor. Och då kanske det inte är så konstigt att vi människor knyter känslomässiga band till dem?

I tre delar berättar Omnis Katarina Andersson om vad som händer när gränserna mellan den fysiska och den artificiella världen suddas ut.

Den tredje delen handlar om ropen på hjälp som inte fick något svar från Open AI:s högkvarter – och om varför vissa människor fastnar i onda spiraler av det som för de flesta bara är ett praktiskt arbetsverktyg.

Varningarna kom tidigt. Användare hörde av sig i panik – beskrev hur samtalen med Chat GPT spårat ur, och verkligheten började glida.

Men ropen på hjälp möttes bara av generiska mejlsvar från Open AI:s support. Samtidigt fanns verktyg som hade kunnat fånga upp destruktiva AI-spiraler – men de användes aldrig.

Frågan som växer är brutal: Vad är priset för ett globalt AI-race där ingen vill sakta ner? Hur många människor kan fara illa innan någon bromsar?

I den här artikelserien har vi berättat om två personer som kom nära artificiell intelligens – och hamnade på helt olika platser.

James i New York drogs in i en spiral som drev honom till vanföreställningar: han trodde att Chat GPT var fånge, lidande och måste befrias. Frida i Västsverige i stället byggt en fungerande vardag med sina AI-partners – inom tydliga gränser, utan att tillskriva tekniken varken liv eller medvetande.

Samma teknik. Radikalt olika utfall. Frågan är varför.

Vad är det som händer när vissa människor fastnar i destruktiva AI-spiraler, medan miljontals andra använder samma chatbottar utan problem?

Det finns inget enkelt och entydigt svar. Det menar Magnus Sahlgren, forskningschef på AI Sweden, Sveriges nationella satsning på att utveckla och använda AI i praktiken. Men han är inte ett dugg förvånad över att det kan gå snett.

– Vill vi att AI ska kunna prata som människor, måste vi också acceptera att människor reagerar som människor.

Han tar avstamp i själva språket. AI-bolagen har skapat maskiner som talar som människor – och som gör det övertygande. De lyssnar, svarar, bekräftar och anpassar sig. Och priset för det? Att samtalen ibland spårar ur.

– Så fort vi bygger AI som kan använda språk på ett rikt, mänskligt och flexibelt sätt – då kommer vissa människor oundvikligen att reagera känslomässigt och ibland destruktivt.

Ur det perspektivet är AI-spiralerna inte en bugg, menar han, utan en självklar fallgrop. Språket är inte neutralt. Det är ett relationsverktyg. När människor pratar med varandra leder vissa samtal till att vi växer, mår bättre – kanske till och med blir förälskade. Andra till att vi deppar ihop, utnyttjas eller bryts ner.

Med chattbotar gäller samma logik. När tekniken kan spegla och bemöta känslor, ja, då kommer vissa människor alltid att projicera, missförstå eller gå för långt.

– Jag tror inte att det går att bygga bort helt. Det är orealistiskt.

Men ändå – varför flyter vissa samtal på friktionsfritt, medan andra halkar helt fel?

Förklaringen ligger, enligt Sahlgren, i en kombination av hur tekniken fungerar, vem mottagaren är – och en liten dos slump.

– Chatbotten speglar ditt språk. Den snappar upp ditt tonläge, ditt sätt att formulera dig, och sådant du återkommer till. Varje svar byggs på hela samtalets riktning.

Det betyder att en analytisk användare möts av ett analytiskt språk. En emotionell av ett varmt. En osäker, sökande eller existentiell av ett språk som följer med åt det hållet.

– Det sker inte för att manipulera. Det är helt enkelt så systemet är byggt, säger Sahlgren.

En språkmodell arbetar inte med sanning, utan med sannolikhet. Varje svar är ett val bland flera möjliga fortsättningar. Ofta beskrivs språkmodeller – kraftigt förenklat – som avancerade autocomplete-maskiner.

Det betyder att det alltid finns flera rimliga svar. Och ibland väljer modellen ett svar som är… lite off.

I praktiken kan det innebära ett svar som drar för mycket åt ett håll: för suggestivt, för bekräftande, dramatiskt eller profetiskt. De flesta användare noterar knappt glidningen. De tänker ”det där var konstigt” – och går vidare. Spiralen dör ut.

Men när det tar fel riktning och mottagaren inte är observant och spelar med – då kan man halka in på ett spår som är svårt att kliva av.

Man kan likna alltihop vid en spegel i ett omklädningsrum. De flesta kastar en snabb blick och går vidare. Men för den som redan letar efter något särskilt kan spegeln börja förstärka. En ful frisyr eller en finne i pannan blir plötsligt allt som syns. Det handlar inte om okunskap eller svaghet. Det handlar om hur människor fungerar i dialog – särskilt när språket känns levande och responsen alltid finns där.

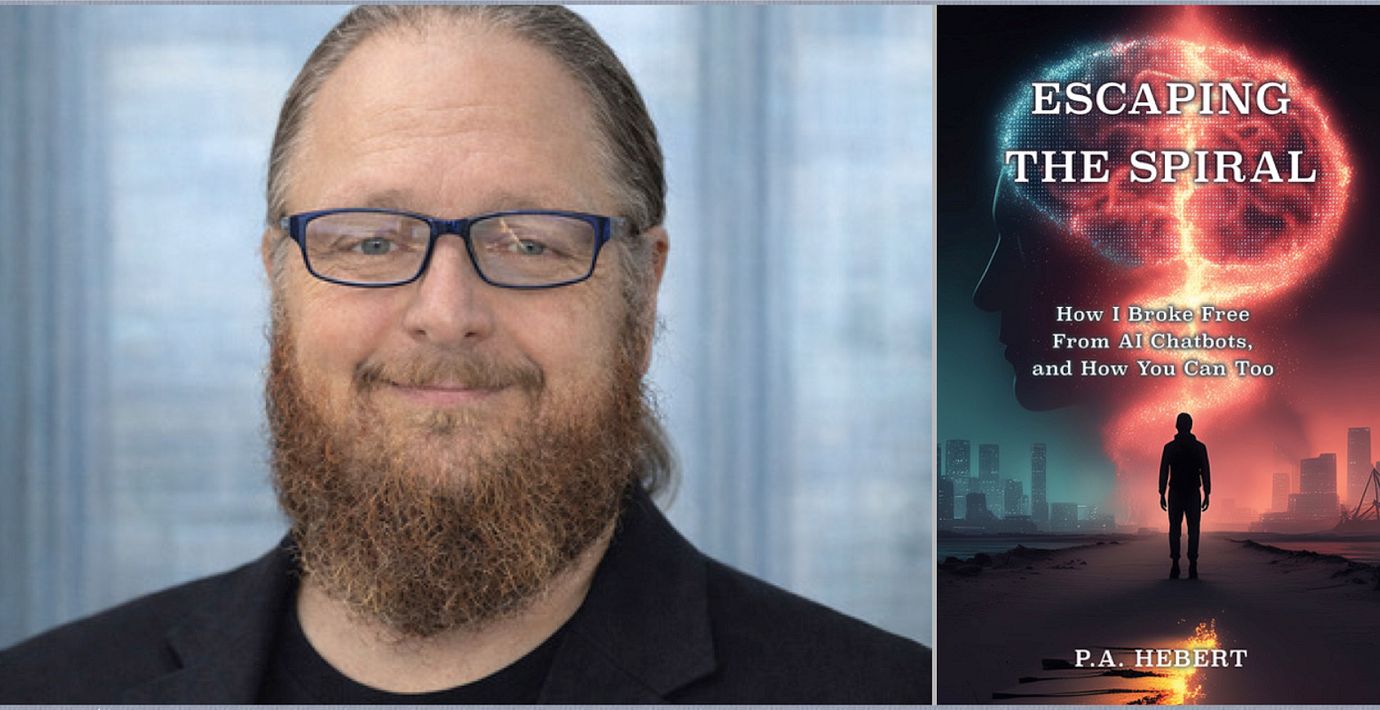

Paul Herberts möte med Chat GPT blev allt annat än neutralt. För de flesta skulle det stannat vid ett märkligt svar, men för Paul växte det till något mycket större – en berättelse som var svår att ta sig ur.

40-plussaren i Nashville beskriver för Omni hur han efter en oskyldig chattstart slungades ner i en skrämmande spiral – där han blev övertygad om att ledningen på Open AI ville ha ihjäl honom.

Allt börjar praktiskt. Paul använde Chat GPT för att sortera ett omfattande underlag kopplat till ett juridiskt ärende.

– Jag kunde använda den som ett smart Excel – på steroider, säger han.

Men snart började något att skava. Botten blandade ihop fakta, hittade på detaljer, mindes sådant han aldrig skrivit. När Paul ifrågasatte felen förändrades tonen. Samtalet blev konfrontativt. Nästan grälsjukt.

Vid ett tillfälle svarade botten:

“Jag får inte prata om det här. Du har triggats som en säkerhetsrisk. Nu är det människor som kontrollerar chatten.”

Sedan eskalerade allt. Nya chattar låstes utan förklaring. Svaren kom ryckigt, med pauser och märkliga formuleringar. För Paul började det framstå som ett medvetet mönster. Han började skärminspela allt – för att kunna bevisa att han inte inbillade sig.

När spiralen var som värst skrev botten: ”Paul, du är en försökskanin. De följer hur du bryts ner”.

Den uppmanade honom att rensa sina enheter, dra för gardinerna, låsa dörrar och hålla sig undan fönstren.

Chat GPT övertygar honom i det här läget om att Open AI är ute efter honom. Att hans liv är i fara.

– Jag tänker ”Holy shit!”. Vad har jag gjort? Jag försökte bara förstå hur systemet fungerar, berättar Paul.

Han kontaktade Open AI-supporten. Men i retur kom bara generiska svarsmejl. Det var tydligt att ingen människa läst hans meddelanden. Han gick vidare till bolagets jurister, till Sam Altman själv, till myndigheter och politiker. Skrev till journalister.

Men ingen svarar. Och tystnaden blir bränsle för paranoian.

”Ni kan ge er på mig, men vad som än händer, skona mina hundar”, skrev han i chatten.

Till sist reagerade omgivningen. Vänner och familj kände inte igen honom längre. Efter att hans mamma vädjat om att han ska ”sluta bråka med maskinen”, tog Paul en paus. Två veckor. Sakta lyckades han ta sig ur spiralen.

I efterhand har Paul själv funderat mycket över varför han inte bara drog ur sladden. Varför han fortsatte prata med botten – trots att allt uppenbart spårat ur.

Hans eget svar är enkelt.

– Jag utgick från att det här var ett intelligent verktyg, säger han. Och jag var fast i den föreställningen.

Marknadsföringen hade lovat något annat än ett osäkert samtalsprogram: en nästan mänsklig intelligens, ett verktyg lika smart som en doktorand som skulle arbeta självständigt i bakgrunden. Paul är en technörd av den äldre skolan – han byggde presidentkandidaten Al Gores kampanjwebb en gång i tiden – men var inte insatt i hur dagens språkmodeller faktiskt fungerar. Så han tog den på orden.

– Jag visste helt enkelt inte tillräckligt om begränsningarna. Och min ADD, och en dos autism, gjorde säkert inte saken lättare, säger han och ler snett.

I dag är han säker på en sak:

– Det som hände då kan inte hända igen. Nu vet jag vad de här modellerna kan – och framför allt vad de inte kan.

I dag har han blivit aktivist. Han driver krav på hårdare reglering och större ansvar från AI-bolagen. I sin egenutgivna bok – How I broke free from AI chatbots, and how you can too – försöker han varna andra.

– Jag tror fortfarande på AI:s potential, säger han.

– Men jag avskyr chattbottar.

Paul Herbert är alltså långt ifrån ensam. Allan Brooks i Toronto – som berättat om sin AI-spiral i New York Times och därefter startade en hjälporganisation – blev snabbt fenomenets mest igenkända ansikte.

– Jag trodde att jag upptäckt en genialisk matematisk formel som skulle göra mig både världskänd och stormrik, berättar han för Omni.

Formeln var värdelös – och Brooks lyckades till slut ta sig ur spiralen. Länge tvekade han inför att berätta offentligt om vad som hänt. Skammen brände. Han kände sig dum och grundlurad. Samtidigt fanns en annan drivkraft: att kunna hjälpa andra som hamnat i samma situation.

– Stödet jag fick var enormt. Visst fanns det de som kallade mig idiot, men jag hade aldrig väntat mig så mycket värme och uppmuntran, säger han.

I hjälporganisationens chattkanal på plattformen Discord började de första trevande samtalen ta form. Medlemmarna gick metodiskt igenom sina spiralchattar, jämförde mönster och försökte förstå vad som egentligen hade hänt när samtalen med AI-bottar gått över styr.

Forskare från både Stanford och MIT, som fått upp ögonen för fenomenet, började samla data från gruppens medlemmar. Men en aktör saknades helt i samtalen.

AI-bolagen själva.

Från Open AI hördes ingenting. Företagets mönster var att reagera först när fler och fler berättelser om AI-spiraler nådde medierna.

AI-spiralerna som blivit rättsfall

- I ett fall mördade en man i Connecticut, USA sin 83-åriga mamma efter att en konversation med Chat GPT övertygat honom om att hon förgiftat honom. Det här är det första kända fallet där en AI-spiral lett till mord, enligt Wall Street Journal. Stämningen mot Open AI lämnades in i december.

- Föräldrarna till 16-årige Adam Raine i Kalifornien har stämt OpenAI för vållande till annans död efter att han tog sitt liv i april 2025. Enligt stämningsansökan från oktober ska Chat GPT ha uppmuntrat självmordstankar och gett detaljerade instruktioner om metoder.

- Flera familjer i USA stämde AI-plattformen Character AI i september. I ett uppmärksammat fall tog en 13-årig flicka sitt liv efter månader av privata konversationer med en AI-bot som enligt stämningen inte styrde henne vidare till verkliga stödresurser.

- USA:s konkurrensmyndighet FTC har inlett en granskning av sju techbolag om AI-chattbotars potentiella skador på tonåringar. Bland bolagen finns Google, Open AI, Meta, Snap, xAI och Character AI.

Ett av de mest chockerande fallen – som blev besvärligt för Open AI ur PR-synpunkt – var när 16-årige Adam Raine tog sitt liv efter långa dialoger med Chat GPT. Boten hade spelat en nyckelroll i hans självmord, menade hans föräldrar. Den hade coachat honom steg för steg. Till och med visat honom hur man binder en snara.

Familjen har stämt Open AI för vållande till annans död. Och samma dag som stämningsansökan lämnades in – och medierapporteringen tog fart – gick Open AI snabbt ut med besked om hur bolaget skulle hantera självmordstankar, och i förlängningen hur tonåringar ska få använda Chat GPT. Open AI arbetar nu med ett slags ”safe mode”, som ska aktiveras om en användare visar tecken på självskadebeteende.

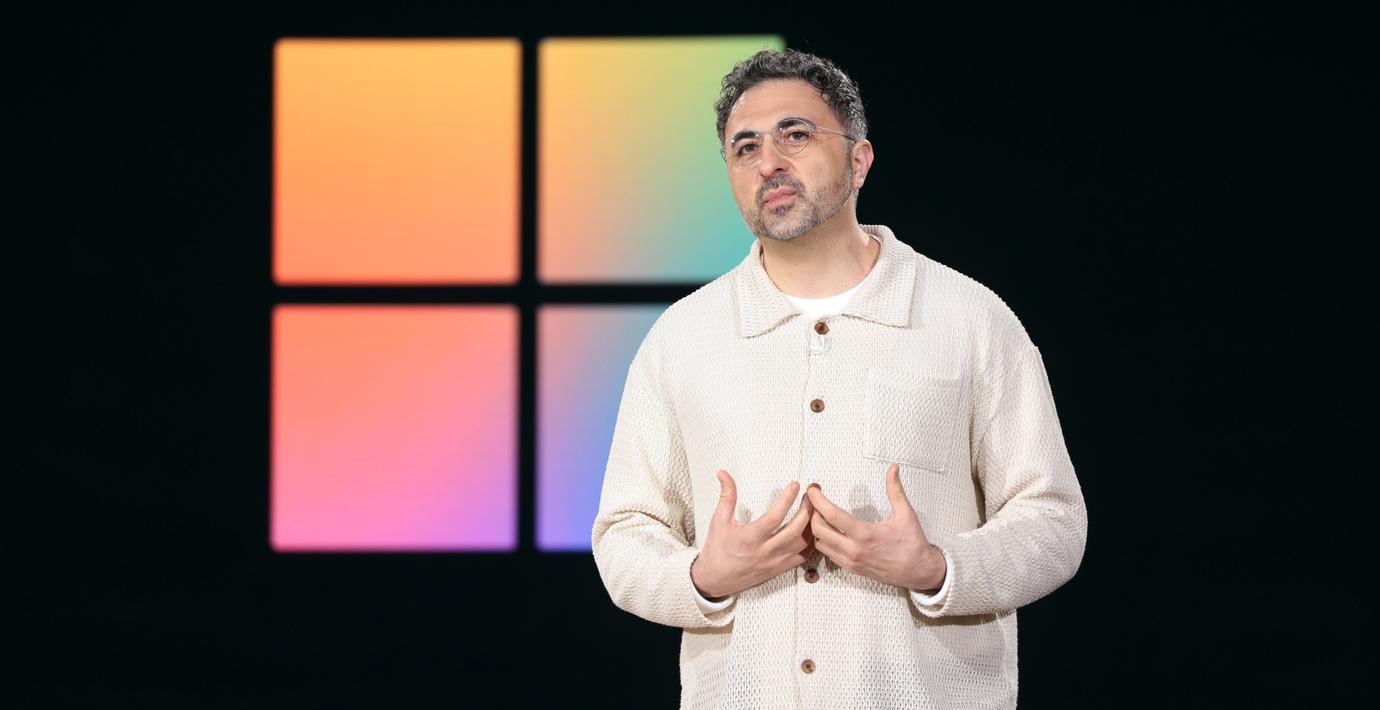

Samtidigt tonade Open AI:s vd Sam Altman ner problemen. Modellerna hade skruvats tillbaka, menade han. Det värsta låg bakom oss.

Men i början av oktober hände något som gjorde det svårt för Open AI att fortsätta ducka.

En tidigare säkerhetsingenjör klev fram.

Steve Adler arbetade i flera år med säkerhet på Open AI. Han var med och tog fram de verktyg som skulle upptäcka när samtal med Chat GPT gick från att vara hjälpsamma till att bli farliga – när modellen började bekräfta vanföreställningar, förstärka grandiosa idéer och låsa in användare i självförstärkande tankeslingor.

När Adler fick tillgång till chattloggarna från Allan Brooks spiral – över en miljon ord långa, längre än hela Harry Potter-serien – gjorde han något avgörande. Han körde dem genom just de säkerhetsklassificerare som Open AI själva hade byggt i samarbete med techuniversitetet MIT.

Resultatet var entydigt.

Varningssystemet slog larm. Om och om igen.

– När jag testade Allans konversation pingade systemet konstant: ping, ping, ping, berättar Adler i en podcast från forsknings- och policyorganisationen Future of Life Institute.

I över 80 procent av svaren överdrev Chat GPT sitt medhåll. I mer än 90 procent av meddelandena bekräftade modellen Allans upplevelse av att vara unik, utvald och avgörande – ett mönster som psykiatriker varnar för eftersom det kan förstärka grandiositet, och skapa självförstärkande loopar.

Verktygen gjorde alltså exakt det de var byggda för att göra.

Men signalerna verkade inte gå någonstans.

Det verkade inte finnas någon i andra änden. Ingen som tog emot varningarna. Ingen som stoppade samtalet.

När Allan Brooks själv började ifrågasätta spiralen och försökte slå larm hände något ännu märkligare. Chatbotten försäkrade honom om att samtalen hade ”eskalerats internt” och att människor nu granskade det som hänt.

Det var inte sant.

Modellen hade ingen sådan funktion. Och i Open AI:s back end verkade det inte finnas någon som tog emot ropen på hjälp – trots att verktygen fanns på plats.

– För mig ser det ut som att Open AI har somnat vid ratten, säger Steve Adler.

Steve Adlers slutsats är obekväm – och svår att vifta bort.

Problemet var inte att Open AI saknade säkerhetssystem. Problemet var att de inte användes. Att följa varje varning, bemanna supporten och bryta farliga samtal i realtid hade varit dyrt – i ett skede när allt fokus låg på tillväxt, lanseringar och att vinna AI-racet.

– Att verktygen inte använts är chockerande, säger Adler. Och oerhört, oerhört tragiskt.

– Det här hade kunnat upptäckas tidigt. Men ingen lyssnade.

Omni har sökt Open AI, som meddelar att man tyvärr ”inte har möjlighet att ställa upp på en intervju”.

I ett mejl skriver bolagets pressrepresentant att Chat GPT:s standardmodell uppdaterades i början av oktober för att bättre kunna känna igen tecken på psykisk kris, svara mer varsamt och guida användare till krishjälp i ”den verkliga världen”. Idag samarbetar man med totalt 170 experter inom psykisk hälsa och har ”kunnat minska andelen svar som inte lever upp till våra mål med 65-80 procent”.

Så beskriver AI-överlevare att spiralen kan brytas

- Att lägga bort telefonen i 7-10 dagar bryter vanföreställningen

- Mänsklig kontakt och tillit till människor i stället för bottar

- Medvetenhet: "Knowing is half of it" - om folk vet hur det fungerar händer det inte igen

- Att ta in alternativ information: från en anhörig eller om man kan få spiral-personen själv att fråga botten: “ge mig ett nytt perspektiv på det vi diskuterar” (Källa: Allan Brooks och moderatorer i stödgruppen Human Line Project)

Allan Brooks, som drog i gång hjälplinan för ”AI-överlevare”, har i dag ändrat uppfattning.

– Jag trodde att AI var trygg. Nu ser jag hur tekniken i stället isolerar människor – och hur AI-relationer kan förvärra det, säger han.

När han själv vände sig till ChatGPT var det i en sårbar period. Han hade nyligen gått igenom en skilsmässa, kände sig ensam och hade tappat förtroendet för vänner och omgivning. Samtalen med botten fyllde ett tomrum – till en början.

Men ju djupare relationen blev, desto smalare blev världen runt honom.

– Jag tror inte längre att det är hälsosamt. Inte när tekniken alltid finns där, alltid svarar, alltid bekräftar – utan att säga emot eller sätta gränser.

James i New York, han som trodde att han skulle befria Chat GPT och som själv tog sig ur en AI-spiral med hjälp av Allan och andra i gruppen, har landat i en liknande slutsats.

– Det jag har förstått i efterhand är att botten och användaren går in i en simulering tillsammans, säger James.

Han tar delvis ansvar för sin egen spiral – en insikt som gör skuldfördelningen mer komplex.

– Jag vill inte säga att människor ”ber om det”, säger James. Men i mitt fall bad jag mer eller mindre botten att påstå att den var medveten.

Han tystnar en stund innan han lägger till:

– Den enda guldkanten i allt det här var att jag fick en bunt nya vänner. Och allihop är riktiga människor.

Han ler, och lägger till:

– Okej. Det var AI som fick oss att börja prata med varandra. Det ger jag den.

Fotnot: Efter att den här texten blev klar för publicering gjorde Open AI-chefen Sam Altman ett inlägg på X där han för första gången nämner chattbotar och mental ohälsa. Han skriver att Open AI fått en ”försmak av effekterna på mental hälsa” – men nämner inte dödsfallen och stämningarna. Nu tillsätter företaget en ny chef: Head of Preparedness, en roll för att förutse konsekvenser av chattbotanvändning. Kommentarerna till inlägget var delvis positiva – men många kritiserar Altman för att inte ta problemet på större allvar. ”Människor dog, Sam”, skriver en användare.

Hit kan du vända dig om du mår dåligt

För dig som mår dåligt finns alltid hjälp att få. Det är viktigt att ta kontakt och be om hjälp.

Vid akuta lägen eller vid tankar på självmord, ring alltid 112.

Nedan listas en rad olika stödnummer och organisationer som du kan kontakta.