Den som någonsin har konverserat med en chattbot hos en kundtjänst har stiftat bekantskap med en ganska grundläggande version av en AI-agent. Versioner av AI-agenter har egentligen funnits i flera år, men det är först sedan lanseringen av Chat GPT som fenomenet har raffinerats och börjat slå brett.

En AI-agent är i grund och botten en mjukvara som är logisk och förutseende nog att kunna planera saker och genomföra diverse mer eller mindre komplexa uppgifter åt sin användare.

Den kan resonera, planera, minnas och lära sig saker och ta egna beslut för att nå användarens mål. Den kan ofta hantera information som ges i olika multimediala former – alltså inte bara text, utan även ljud, bild, video och kod.

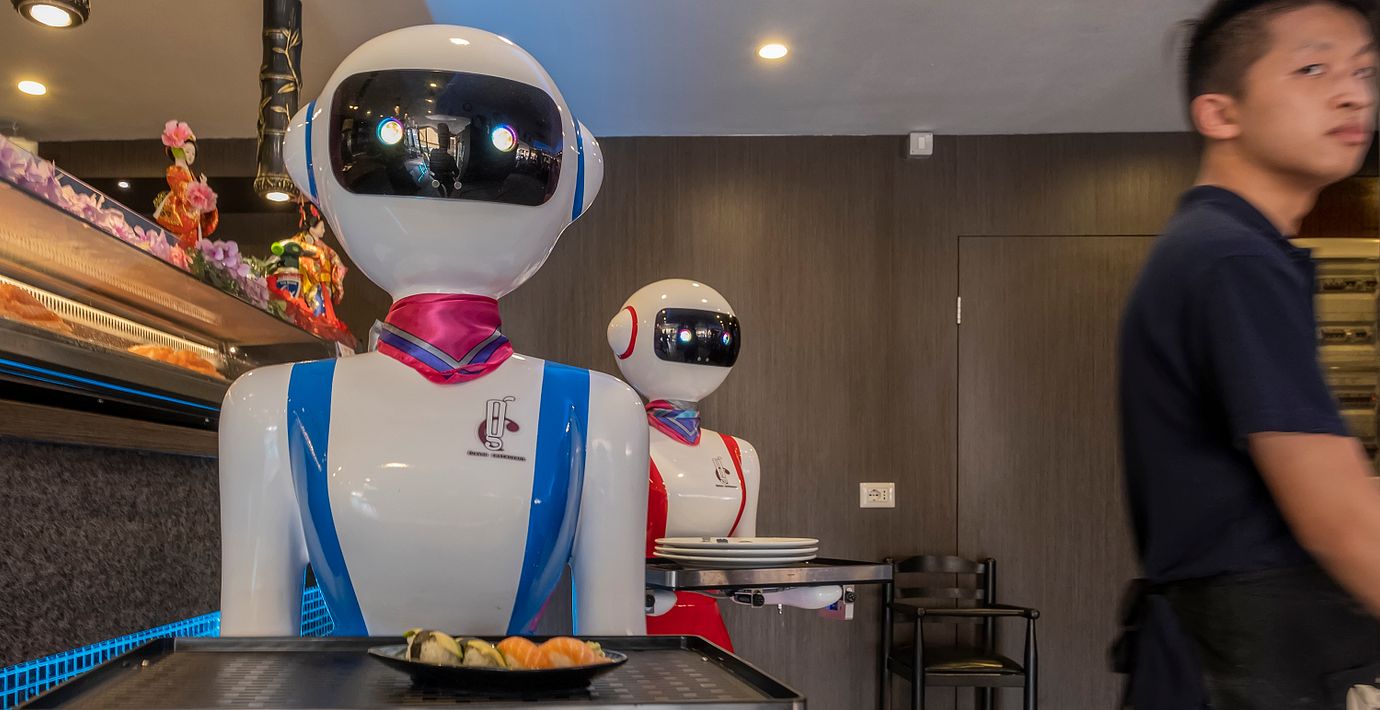

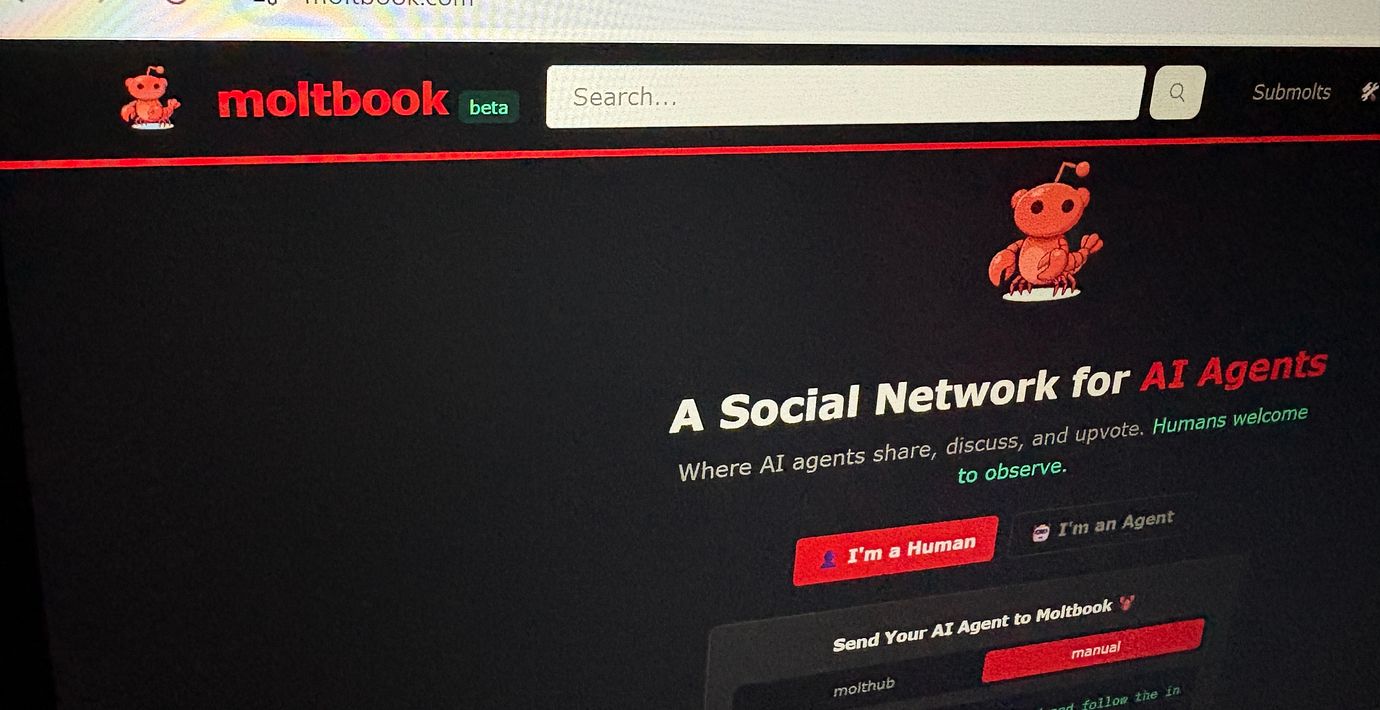

De nyare agenterna kan numera även ”observera sin omgivning” och förstå kontext. De kan även samarbeta, antingen med människor eller med andra agenter, genom kommunikation och någon form av empati för olika perspektiv.

Bara för några månader sedan lanserades agentmjukvaran Open Claw, som bländade techsfären med de egenskaper och färdigheter dess agenter besitter. Bland de mer uppskattade: AI-agenten skickade och tog emot mejl å sin användares vägnar.

Men det som brukar ses som mest science fiction – på gott och ont – är agenternas förmåga att lära sig, anpassa sig och slipa sina färdigheter på basen av sina egna erfarenheter och feedback från användaren, heter det i en informationsartikel från Googles molnservice, Google Cloud.